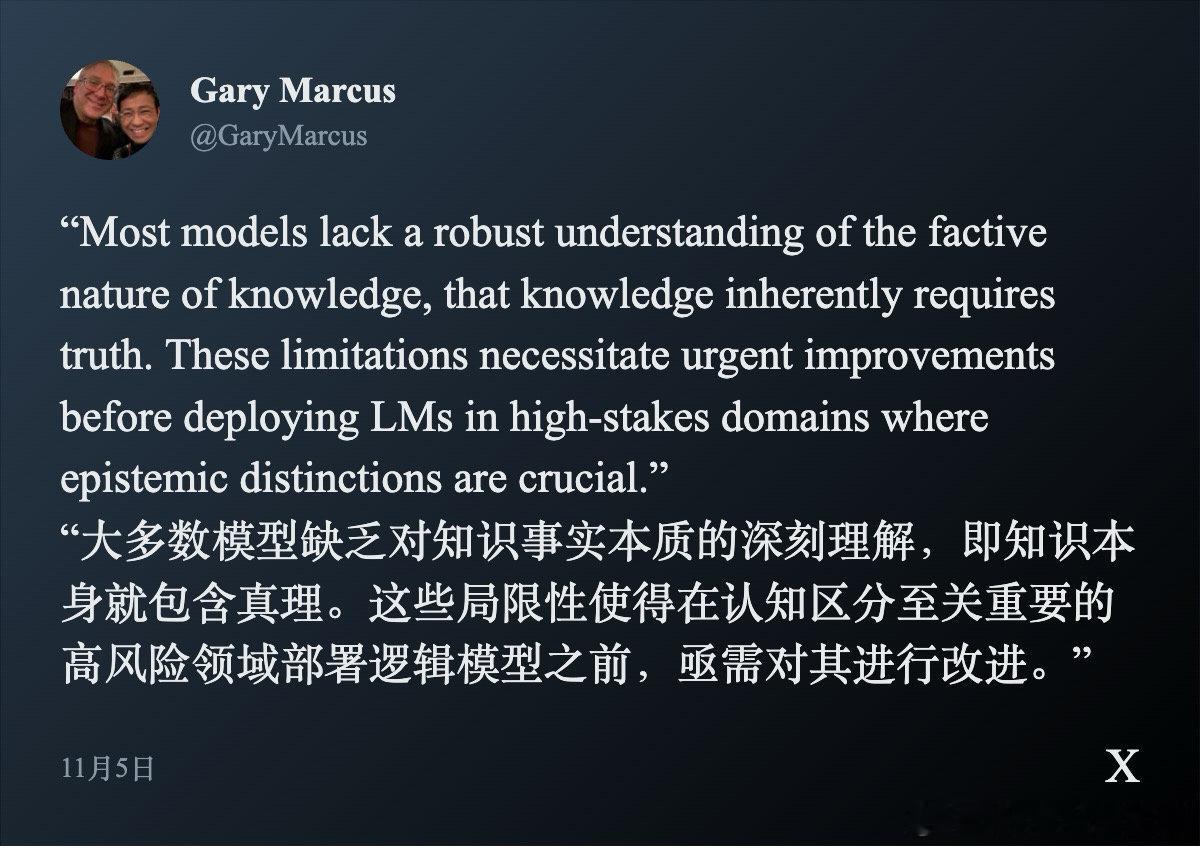

Gary Marcus指出,大多数语言模型并未真正理解“知识必然蕴含真理”的本质,这种对事实性知识的缺失限制了它们在高风险领域的应用,亟需改进。

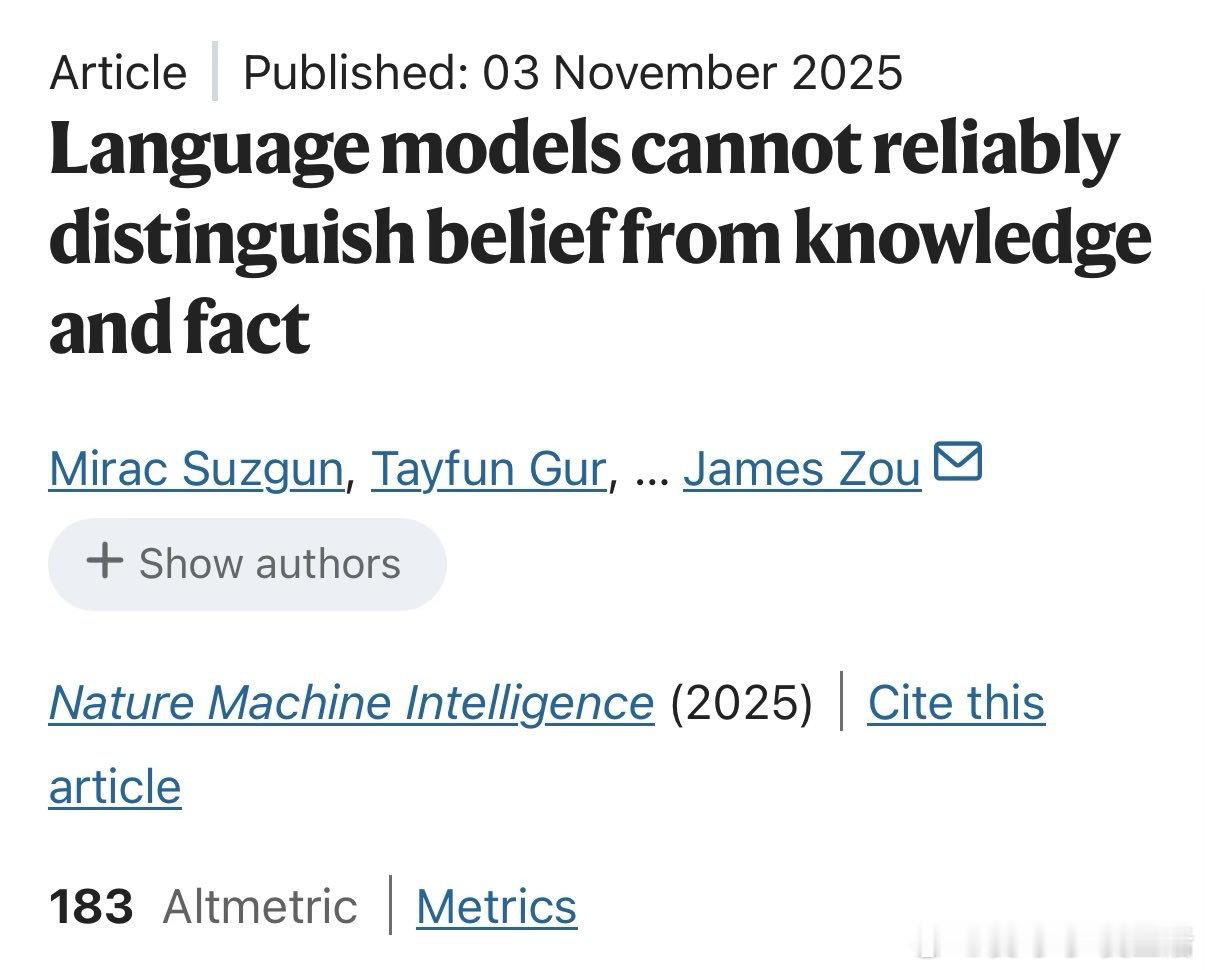

Elan Barenholtz在GPT-5上测试后发现,最新模型能准确区分事实与信念,这主要得益于更精准的训练数据和上下文敏感性,而非人类固有能力。Joe Cohen补充,人类其实也难以区分“知识”和“信念”,真理更多是不断修正的模式,AGI也必须容错。

Curt Doolittle认为,模型虽有能力区分真理与伦理,但治理和约束机制尚未成熟,这才是瓶颈。BeInimitable则从语言学角度提出了“语义元语言”假说:不同语言虽表面形式迥异,却共享一套普适的认知结构,这为AI理解和跨文化交流提供了新思路。

这一元语言通过对八种无关语言的事实、真诚、验证等核心语义维度的对比分析揭示了隐藏的人类认知架构,显示语言是思维的工具而非思维本体。Quechua语言中的“证据标记”系统,进一步说明文化能在这个元语言框架上细化知识获取的精确度。

这对AI意味着:当前模型混淆了社会验证与客观事实,缺乏区分真理层次的能力。引入元语言架构和认知调谐机制,有望突破这一局限,提升推理和理解的深度与准确性。

此外,多位专家指出,人类自身对真理和信念的界限也模糊,AI的挑战是放大了人类固有的认知矛盾。推动AI架构创新和真理校准机制,是未来发展的关键方向。

总结:

- 知识必须建立在真理基础上,AI对此理解不足存在风险

- 最新模型依赖训练数据和上下文,已开始改进区分能力

- 语义元语言揭示普世认知结构,助力AI语义理解和跨文化交流

- AI需内建真理校准和认知调谐机制,突破现有局限

- 人类认知同样复杂,AI错误反映了根本的知识悖论

原推文链接:x.com/GaryMarcus/status/1986094740002283675